12月8日快讯,当前ai已然成为智能手机领域不可忽视的核心要素,生成式人工智能与大规模语言模型正深度融入移动终端,为用户带来文档智能摘要、语音实时转文字、图像智能编辑等一系列高效便捷体验。

然而,AI功能的广泛应用也催生了新的挑战——过去大多数AI能力依赖云端大模型进行运算,不仅存在用户隐私数据上传至远程服务器而泄露的风险,还易受网络质量制约,出现响应延迟、断网即失效等问题,显著削弱实际使用体验。

正是敏锐捕捉到这一行业共性难题,主流终端厂商加速推进端侧AI战略,依托强劲的芯片级算力支撑,在设备本地完成全部AI推理任务,确保敏感信息“不出设备”,既从根本上杜绝数据外泄隐患,又保障了毫秒级响应速度与全天候可用性。

在此背景下,联发科全新旗舰芯片天玑9500凭借开创性的双NPU协同架构强势破局,将顶级AI算力真正扎根于终端设备本身,不仅交付更流畅、更强大的智能交互体验,更构建起覆盖硬件底层、系统框架到应用层的全栈式隐私保护机制,重新树立了高端智能手机端侧AI安全的新标杆。

在AI手机加速普及的今天,语音助手实时多语种翻译、会议录音一键转写、AI图像增强与创意生成等功能已成旗舰机型标配。但若这些功能仍依赖云端处理,则用户的语音片段、拍摄照片、私人文档等高敏感内容必须上传至第三方服务器,隐私风险显而易见。

无论是商务人士录制的重要谈判音频,还是普通用户日常拍摄的家庭影像,一旦进入公有云环境,便可能面临被截获、误用甚至滥用的潜在威胁。更关键的是,在高铁、航班、地下车库等弱网或无网环境中,所有云端AI功能将直接瘫痪,无法满足用户对即时响应的核心诉求。

端侧AI的规模化落地,正是破解上述困局的关键路径——所有AI计算全程在手机本地闭环执行,原始数据无需上传、不离设备,从源头筑牢隐私防线,同时实现真正的离线可用与零延迟响应。而这一能力能否真正落地,核心取决于芯片中NPU(神经网络处理器)的算力密度、能效比与安全可信等级。天玑9500所采用的双NPU设计,恰为这一需求提供了坚实可靠的硬件底座。

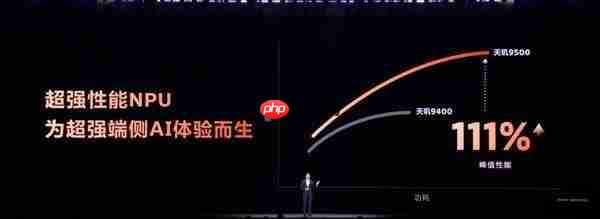

作为联发科面向下一代AI终端打造的旗舰级SoC,天玑9500首次集成超性能NPU 990与超能效NPU两大独立AI处理单元,从芯片底层全面兼顾“高性能、低功耗、高安全”三大端侧AI核心诉求。

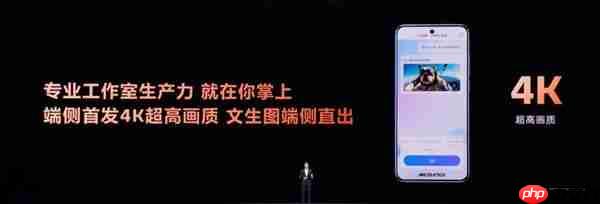

其中,超性能NPU 990峰值AI算力相较前代跃升111%,在权威AI基准测试苏黎世AI BenchMark中斩获超15000分的全球领先成绩,可轻松驾驭4K分辨率文生图、跨模态长文本理解与结构化摘要等高复杂度AI任务。

其内置的生成式AI引擎2.0率先支持BitNet 1.58bit超低比特大模型原生运行,通过定制化固化电路与创新内存压缩技术,在大幅缩减模型存储占用的同时,将满载状态下的功耗降低56%,达成“算力翻倍、功耗减半”的能效跃迁。

标签: 联发科 天玑9500 处理器 人工智能 oppo b站 台积电 栈 ai 小红书 神经网络 ai绘画 大模型 智能手机

还木有评论哦,快来抢沙发吧~