如何将deepseek部署到本地?

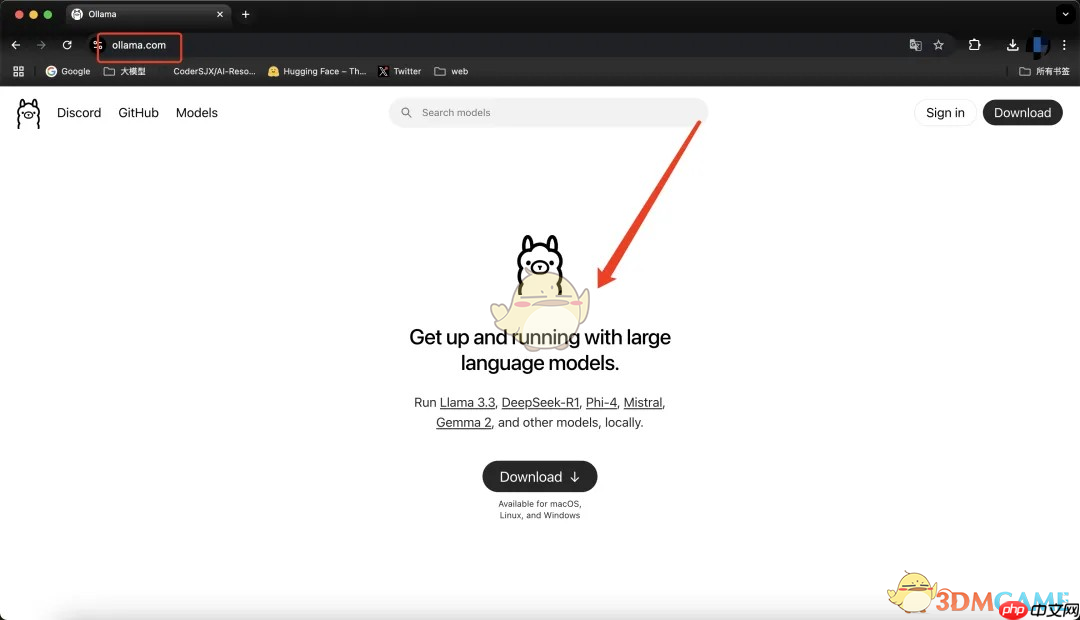

第一步:安装ollama运行环境

首先前往Ollama官方网站,下载适用于你操作系统的客户端程序。Ollama支持Windows、MacOS以及Linux三大平台,国内用户可直接访问官网进行下载,安装流程简单快捷,无需复杂配置。

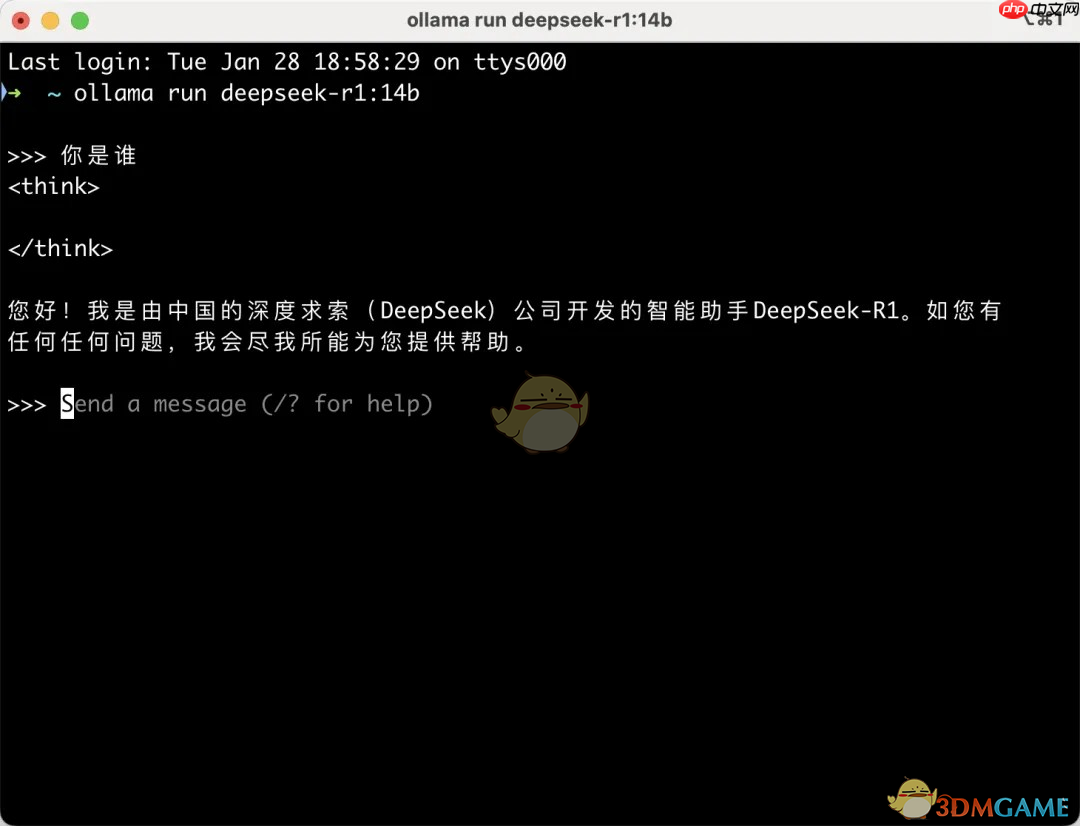

第二步:执行命令拉取并运行DeepSeek R1模型

完成Ollama安装后,打开终端或命令行工具,输入以下指令:

bash复制编辑ollama run deepseek-r1:7b

该命令会自动从服务器下载DeepSeek R1的7B版本模型,并在本地完成部署。

部署成功后,即可开始体验DeepSeek R1强大的语言推理与生成能力。

若想尝试性能更强的模型,请继续查看下方进阶指南。

进阶功能说明

1、判断设备是否满足模型运行条件

能否顺利运行特定参数规模的模型,关键取决于显卡的显存容量。

即使使用如GTX 1080、RTX 2080这类较早发布的显卡,只要显存充足,也能流畅运行DeepSeek系列模型。

核心原则是:显存足够,就能运行。

以下是常见模型对显存的需求参考表:

显卡显存需求明细

2、选择合适参数量的模型版本

标签: deepseek linux docker windows 操作系统 显卡 端口 工具 mac macos win co

还木有评论哦,快来抢沙发吧~