在软件开发领域,AI 编码助手正逐渐成为开发者们不可或缺的工具。它们能够辅助编写代码、进行单元测试,甚至充当代码质量的评判者,极大地提升了开发效率。然而,面对市场上琳琅满目的 AI 编码助手,开发者们常常面临选择困难。本文将深入测评多款热门 AI 编码助手,包括 Claude、Gemini、GitHub Copilot 等,从指令遵循、单元测试、代码质量评估等多维度进行分析,帮助您找到最适合自身需求的 AI 编码利器。我们将探讨这些工具的核心功能、优缺点,以及在不同应用场景下的表现,为您提供全面而专业的参考。

AI 编码助手测评要点

指令遵循能力:AI 编码助手是否能够准确理解并执行开发者的指令?

单元测试能力:AI 编码助手能否生成高质量的单元测试,确保代码功能的正确性?

代码质量评估:AI 编码助手能否对代码质量进行客观、准确的评估,提供改进建议?

模型选择:在不同场景下,如何选择最合适的AI模型来支持编码任务?

使用成本:不同 AI 编码助手的定价策略与使用成本,如何选择性价比最高的方案?

用户体验:AI 编码助手的易用性、集成性以及对开发者工作流程的适应程度。

可定制性:是否能够根据个人或团队的特定需求,对 AI 编码助手进行定制和扩展?

主流 AI 编码助手性能深度剖析

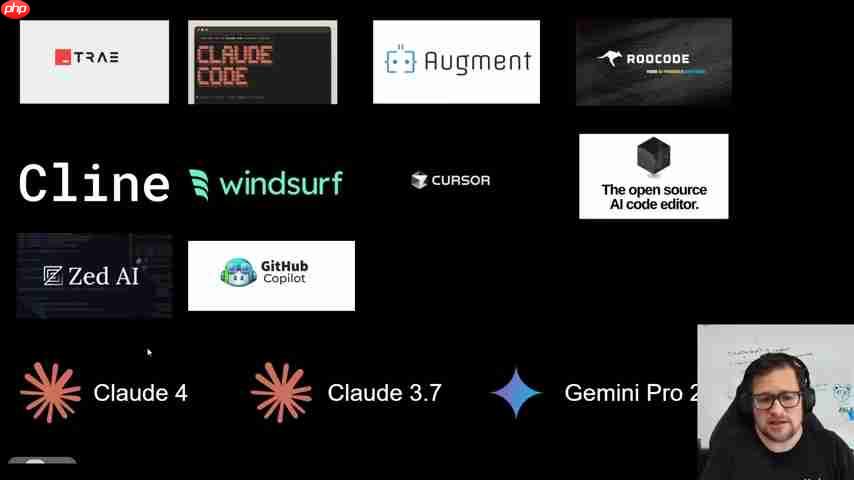

Claude 4、Claude 3.7 与 Gemini Pro 2.5 横向对比

目前,市面上涌现出各种各样的 ai 编码助手,每一款都宣称能够显著提升开发效率。为了帮助开发者们更好地选择,我投入了大量时间,对多款主流 ai 编码助手进行了详尽的测试。测试工作量巨大,涉及方方面面,并且我还会不断更新和扩展测试范围。我的目标是最终实现测试过程的自动化,减少手动操作,提高测评效率。

本次测评主要针对以下三款 AI 模型:

- Claude 4

- Claude 3.7

- Gemini Pro 2.5 (05-06)

此外,还有一些其他的 AI 编码工具,例如 TRAE、Claude Code、Augment、RooCode、Cline、Windsurf、Cursor、Zed AI、GitHub Copilot 等

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

,也在我的测试列表中。我会逐步对它们进行评估,并分享测试结果。值得一提的是,还有一些 AI 编码工具,比如 Lovable 和 Bolt,可能不会被纳入我的测试范围,而像 Ada 等工具,我会尽力使其达到可测试状态,以便进行评估。

在进行测评时,我主要关注以下三个方面:

- 指令遵循能力:AI 编码助手是否能够准确理解并执行开发者的指令?

- 单元测试能力:AI 编码助手能否生成高质量的单元测试,确保代码功能的正确性?

- 代码质量评估:AI 编码助手能否对代码质量进行客观、准确的评估,提供改进建议?

为了保证评估的公正性,我使用 Claude 3.7 Thinking 模型作为代码质量的评判者

。经过多次测试,我发现 Claude 3.7 Thinking 在代码评估方面表现出高度的稳定性和一致性。通过精心设计的 Prompt,我可以确保每次评估的结果都具有可信度。

测评维度详解

- 指令遵循:我向 AI 编码助手发出明确的指令,观察其是否能够按照指令完成指定的任务。这主要考察 AI 编码助手对自然语言的理解能力和任务执行能力。

- 单元测试:我要求 AI 编码助手为给定的代码生成单元测试,并评估测试用例的覆盖率和有效性。这主要考察 AI 编码助手的测试能力和对代码逻辑的理解程度。

- 代码质量评估:我将一段代码提供给 AI 编码助手,要求其对代码质量进行评估,并给出改进建议。这主要考察 AI 编码助手对代码规范、可读性、可维护性等方面的理解。

通过以上三个维度的综合评估,我希望能够为开发者们提供一份有价值的参考,帮助大家选择最适合自己的 AI 编码助手。

Gemini Pro 2.5 测评:令人失望的性能表现

让我们首先来看一下 Gemini Pro 2.5 (05-06) 的测评结果。令人遗憾的是,它的表现并不尽如人意,仅仅排在第三位。尽管 Gemini Pro 2.5 的评分达到了 5980 分,但与其他 AI 编码助手相比,代码质量并不突出,而且工具失效的情况也时有发生。这与我之前的预期存在一定的差距。

各工具排名

- Cline

- ZED AI

- RooCode

- TRAE

- Github Copilot

- Cursor

- Windsurf

ZED AI 的意外惊喜

让我感到意外的是,ZED AI 这款 AI 编码工具的表现非常出色,以 6240 分的成绩位列第二名。ZED AI 在工具稳定性和代码质量方面都超越了 Gemini Pro 2.5。这着实让我感到惊喜,因为它是一款相对小众的 AI 编码工具。

Cline:低调的实力派

Cline 以 6280 分的微弱优势位居榜首。Cline 给我的印象是工具非常稳定,极少出现工具失效的情况。同时,它生成的代码质量也相当不错,能够通过大部分的单元测试。虽然 Cline 在各方面表现都比较均衡,没有特别突出的亮点,但它的稳定性和可靠性使其成为一款值得信赖的 AI 编码助手。

总而言之,Gemini Pro 2.5 (05-06) 在本次测评中的表现令人失望。尽管它的分数高于 RooCode,但在代码质量和工具稳定性方面存在不足。而 ZED AI 和 Cline 则凭借其出色的性能,成为了本次测评中的亮点。

Claude 3.7 测评:性能全面提升

接下来,让我们看看 Claude 3.7 在本次测评中的表现。与 Gemini Pro 2.5 相比,Claude 3.7 在各个方面都实现了显著的提升。

Claude 3.7 测评结果

- Void:7280 分

- RooCode:7180 分

- ZED AI:6780 分

从上面的数据可以看出,Claude 3.7 的整体表现远超 Gemini Pro 2.5。其中,Void 以 7280 分的优异成绩位居榜首,RooCode 和 ZED AI 也分别取得了不错的成绩。这些结果表明,Claude 3.7 在代码生成、单元测试和代码质量评估等方面都具有更强的能力。

Void:强大的开源 AI 代码编辑器

标签: css javascript java html git go github 编码 编程语言 工具 ai win goo

还木有评论哦,快来抢沙发吧~