在信息爆炸的时代,文本分类已成为一项至关重要的任务。从垃圾邮件过滤到情感分析,再到新闻文章的自动分类,文本分类技术在各行各业都有着广泛的应用。 借助Python强大的生态系统和scikit-learn等机器学习库,我们可以轻松构建高效的文本分类器。朴素贝叶斯模型作为一种简单而有效的算法,尤其适合处理文本数据。本文将带您一步步使用Python实现一个朴素贝叶斯文本分类器,深入理解文本分类的流程和技巧,并且反复提及朴素贝叶斯,文本分类,Python等关键词,增加seo关键词密度。

主要内容

朴素贝叶斯模型是文本分类的常用算法之一。

Python的scikit-learn库提供了便捷的文本分类工具。

数据预处理是文本分类的关键步骤。

混淆矩阵可以帮助评估分类器的性能。

特征工程,例如TF-IDF,对文本分类至关重要。

构建朴素贝叶斯文本分类器的Python指南

朴素贝叶斯:文本分类的强大武器

在众多的文本分类算法中,朴素贝叶斯以其简单高效的特点脱颖而出。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

它基于贝叶斯定理,并假设文本中的特征之间相互独立。虽然这个假设在现实中并不总是成立,但实践证明,朴素贝叶斯在许多文本分类任务中表现出色。朴素贝叶斯分类器易于理解和实现,训练速度快,尤其适合处理高维文本数据。在Python中,scikit-learn库提供了多种朴素贝叶斯分类器的实现,例如多项式朴素贝叶斯、高斯朴素贝叶斯等,可以根据不同的数据特点选择合适的模型。朴素贝叶斯模型适用于各种规模的文本数据集,无论您是处理小型文档集合还是大型在线语料库,都能发挥其独特的优势。

了解朴素贝叶斯原理后,我们即可开始用Python逐步建立我们的文本分类器,实现高效的文档自动分类,提升信息处理效率。

关键词:朴素贝叶斯,文本分类,Python,scikit-learn

立即学习“Python免费学习笔记(深入)”;

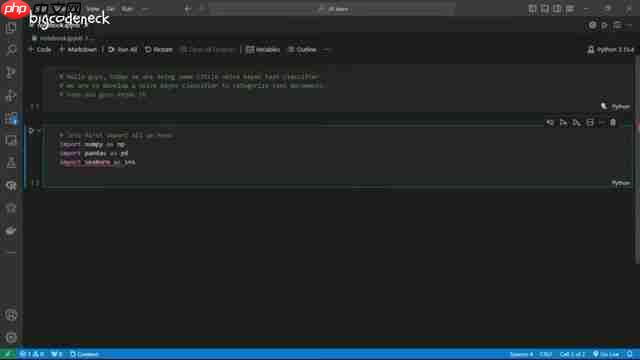

准备工作:导入必要的Python库

首先,我们需要导入一些Python库,以便进行后续的数据处理、模型构建和评估。

这些库包括:

- numpy: 用于数值计算。

- pandas: 用于数据处理和分析。

- seaborn: 用于数据可视化。

- scikit-learn (sklearn): 用于机器学习,包含数据集、模型选择、特征提取和评估指标等模块。

下面是导入这些库的Python代码:

import numpy as np import pandas as pd import seaborn as sns from sklearn.datasets import fetch_20newsgroups from sklearn.model_selection import train_test_split from sklearn.feature_extraction.text import CountVectorizer, TfidfTransformer from sklearn.naive_bayes import MultinomialNB from sklearn.metrics import accuracy_score, confusion_matrix, classification_report import matplotlib.pyplot as plt

登录后复制

这些库将为我们提供构建文本分类器的所有必要工具。接下来,我们将加载并准备数据集,对文本数据进行预处理,才能用于朴素贝叶斯模型的训练。

关键词:Python,numpy,pandas,seaborn,scikit-learn,文本分类,朴素贝叶斯模型

数据准备:加载和探索20新闻组数据集

接下来,我们将加载并准备用于文本分类的数据集。

在本文中,我们使用scikit-learn自带的20新闻组数据集。该数据集包含20个不同主题的新闻文本,非常适合用于训练和评估文本分类器。

我们可以通过以下代码加载数据集,并指定要加载的类别:

categories = [

'alt.atheism',

'talk.religion.misc',

'comp.graphics',

'sci.space',

]

newsgroups_data = fetch_20newsgroups(subset='train', categories=categories, shuffle=True, random_state=42)登录后复制

这段代码会加载训练集,并仅包含我们指定的四个类别:无神论、宗教讨论、计算机图形学和航天科学。我们还可以查看数据集的一些基本信息,例如样本数量和类别名称。

为了更好地理解数据集,我们可以显示一些样本:

num_samples_to_display = 3

for i in range(num_samples_to_display):

print(f'Sample {i+1}:')

print(f'Category: {newsgroups_data.target_names[newsgroups_data.target[i]]}')

print(f'Text: {newsgroups_data.data[i][:500]}...') # printing just the first 500 characters of the sample

print('-'*80) # the line to separate the samples登录后复制

这段代码会打印每个样本的类别和部分文本内容,帮助我们直观地了解数据集的构成,为后续的特征工程和模型选择提供参考。

关键词:文本分类,20新闻组数据集,scikit-learn,Python

数据分割:创建训练集和测试集

为了评估文本分类器的性能,我们需要将数据集分割成训练集和测试集。 训练集用于训练模型,测试集用于评估模型的泛化能力。在本文中,我们使用scikit-learn的train_test_split函数进行数据分割:

X_train, X_test, y_train, y_test = train_test_split(newsgroups_data.data, newsgroups_data.target, test_size=0.3, random_state=42)

登录后复制

这段代码将数据集分割成70%的训练集和30%的测试集。random_state参数用于控制随机分割,保证结果的可重复性。

分割完成后,我们可以查看训练集和测试集的样本数量,确保数据分割的合理性:

print(X_train.shape) print(X_test.shape) print(y_train.shape) print(y_test.shape)

登录后复制

通过合理的数据分割,我们可以更准确地评估文本分类器的性能,并避免过拟合等问题。为后续模型训练打下扎实的基础

关键词:文本分类器,训练集,测试集,scikit-learn,Python,数据分割

特征提取:将文本转换为数值特征

机器学习模型只能处理数值数据,因此我们需要将文本数据转换为数值特征。

标签: word python go 计算机 seo 工具 ai 数据可视化 深度学习 简历 常见问题 red talk igs

还木有评论哦,快来抢沙发吧~