随着人工智能技术的飞速发展,代码生成语言模型正逐渐成为软件开发领域的一颗新星。这些模型利用深度学习技术,能够根据自然语言描述或其他形式的指令,自动生成计算机代码。这种能力不仅极大地提高了开发效率,还降低了软件开发的门槛,使得更多的人能够参与到编程过程中来。 从最初的辅助代码片段生成到如今能够构建完整的应用程序,代码生成语言模型的能力正在不断增强。它们通过学习大量的代码库和相关的文档资料,理解编程语言的语法、语义以及最佳实践,从而能够生成高质量、可维护的代码。然而,尽管代码生成语言模型取得了显著的进展,但仍然面临着诸多挑战。例如,如何保证生成代码的正确性、如何处理复杂的编程逻辑、如何适应不同的编程风格和规范等问题,都是当前研究的热点。此外,随着模型规模的不断扩大,如何降低计算成本、提高训练效率也成为了亟待解决的问题。本文旨在对代码生成语言模型的现状、挑战以及未来的发展趋势进行全面的探讨,为相关领域的研究者和开发者提供参考。

关键要点

代码生成语言模型旨在提升软件开发效率并降低编程门槛。

这些模型通过学习大量代码和文档,理解编程语言的规则。

尽管进步显著,但保证生成代码的正确性仍是一个挑战。

计算成本和训练效率是模型规模扩展的重要考量因素。

未来的研究将着重于提高模型的智能和适应性。

预训练多任务语言模型是解决单任务模型局限性的有效方法。

收集标注的训练数据需要大量的精力和成本。

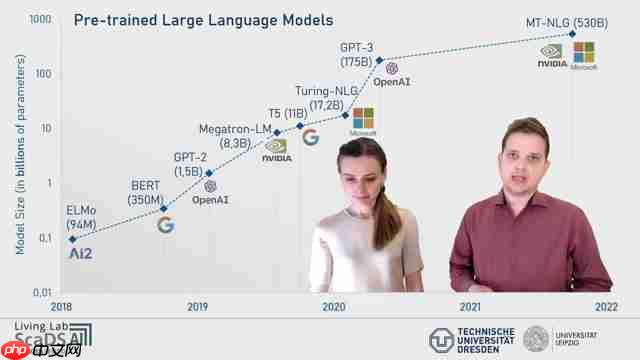

模型的参数规模在不断增大,计算需求也在增长。

Transformer架构已成为主流,并不断演进。

自动化代码生成将支持开发人员完成代码相关任务,以提高生产力

代码生成语言模型的概述

什么是代码生成语言模型?

代码生成语言模型是一种人工智能模型,它使用自然语言处理(nlp)技术来理解人类的意图,并将这些意图转化为可执行的计算机代码。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

这种模型通常基于深度学习架构,例如循环神经网络(RNN)和Transformer,并经过大量的代码数据训练,使其能够理解各种编程语言的语法和语义。简单来说,代码生成语言模型就像一个智能的程序员助手,它可以根据你的需求,自动生成相应的代码,从而极大地提高编程效率和降低开发成本。 代码生成语言模型的核心功能在于它能够将高级的、人类可读的描述(例如自然语言指令)转化为低级的、机器可执行的代码。这种转化过程涉及多个步骤,包括:

- 自然语言理解:模型首先需要理解输入的自然语言描述,提取出用户的意图和需求。

- 代码生成:模型根据理解的意图,生成相应的代码片段或完整的代码文件。

- 代码优化:模型对生成的代码进行优化,例如去除冗余代码、提高代码效率等。

在实际应用中,代码生成语言模型可以用于各种不同的编程任务,例如:

- 自动化测试:自动生成测试用例,提高测试覆盖率。

- 代码补全:根据已有的代码,预测并生成后续的代码片段。

- API调用:自动生成API调用代码,简化API的使用。

- 软件开发:根据需求描述,自动生成完整的软件应用程序。通过自动代码生成可以支持开发人员完成代码相关任务,以提高生产力。

经典单任务语言模型及其局限性

在代码生成语言模型的发展初期,研究人员主要关注单任务语言模型。

这些模型通常针对特定的编程任务进行训练,例如代码补全、代码翻译等。虽然这些模型在各自的任务上取得了不错的效果,但由于缺乏通用性和泛化能力,难以适应不同的编程场景。具体来说,经典单任务语言模型存在以下几个主要的局限性:

- 数据依赖性:单任务模型通常需要大量的标注数据进行训练,而标注数据的获取往往需要耗费大量的人力和时间。

- 任务局限性:单任务模型只能解决特定的编程任务,难以应对复杂多变的编程需求。

- 鲁棒性不足:单任务模型对于输入数据的变化非常敏感,容易受到噪声和异常数据的影响。

-

迁移能力差:单任务模型难以将学习到的知识迁移到其他相关的编程任务中。

单任务模型 trained on labeled data,经常缺乏鲁棒性和灵活性,无法应对实际开发中复杂多变的场景。

例如,一个专门用于代码补全的模型,可能无法很好地完成代码翻译的任务;一个在Java代码上训练的模型,可能无法很好地处理Python代码。这种局限性严重阻碍了代码生成语言模型在实际应用中的推广。 此外,收集标注的训练数据涉及大量的精力和成本,包括自然语言和代码,需要专业的编程知识来正确标注代码片段。

为了克服单任务模型的局限性,研究人员开始探索多任务语言模型。这些模型通过共享参数和学习通用表示,能够同时处理多个不同的编程任务,从而提高模型的泛化能力和鲁棒性。 多任务语言模型使用大量未标记的数据进行无监督的预训练,然后适应各种任务,可以减少任务范围内标记数据的需求。

预训练多任务语言模型:解决之道

为了克服经典单任务语言模型的局限性,研究人员提出了预训练多任务语言模型

。这种模型首先在大规模的未标注数据上进行预训练,学习通用的语言表示,然后在特定的编程任务上进行微调,从而能够快速适应不同的编程场景。预训练多任务语言模型的核心思想在于迁移学习。通过在大规模数据上进行预训练,模型能够学习到通用的语言知识和编程规则,这些知识可以被迁移到各种不同的编程任务中。这样,模型在新的任务上只需要进行少量的微调,就能够取得不错的效果。 预训练多任务语言模型不仅可以提高模型的泛化能力,还可以减少对标注数据的依赖。由于模型已经学习到了通用的语言知识,因此在新的任务上只需要少量的标注数据就可以进行微调。这大大降低了标注数据的获取成本,使得代码生成语言模型能够更容易地应用于各种不同的编程场景。

预训练多任务语言模型的优势主要体现在以下几个方面:

- 提高泛化能力:通过学习通用语言表示,模型能够更好地适应不同的编程任务。

- 降低数据依赖:减少对标注数据的依赖,降低数据获取成本。

- 加速模型训练:通过迁移学习,模型能够更快地适应新的任务。

- 提高模型鲁棒性:通过学习大规模数据,模型能够更好地处理噪声和异常数据。

预训练多任务语言模型已经成为代码生成领域的主流方法,例如:

标签: python java 计算机 人工智能 谷歌 编程语言 工具 ai switch openai gpt 微软 神经网络

还木有评论哦,快来抢沙发吧~