随着人工智能技术的飞速发展,大型语言模型(LLM)如ChatGPT和Gemini等AI工具已经渗透到我们生活的方方面面。 在这个AI驱动的时代,一个关键的问题浮出水面:质量保证(QA)工程师是否需要了解LLM的创建过程?本文将深入探讨QA工程师在LLM应用中的角色,重点讨论测试、自动化和评估AI模型,并分析QA工程师是否需要掌握LLM创建的专业知识,帮助您更好地理解QA工程师在AI驱动的未来中扮演的关键角色,从而抓住AI带来的职业发展机遇。

关键要点

LLM代表大型语言模型,如ChatGPT和Gemini,它们通过海量文本数据进行训练,能够理解和生成类似人类的语言。

QA工程师无需从头开始构建LLM,但需要理解LLM的行为模式,以便进行有效的功能测试和评估。

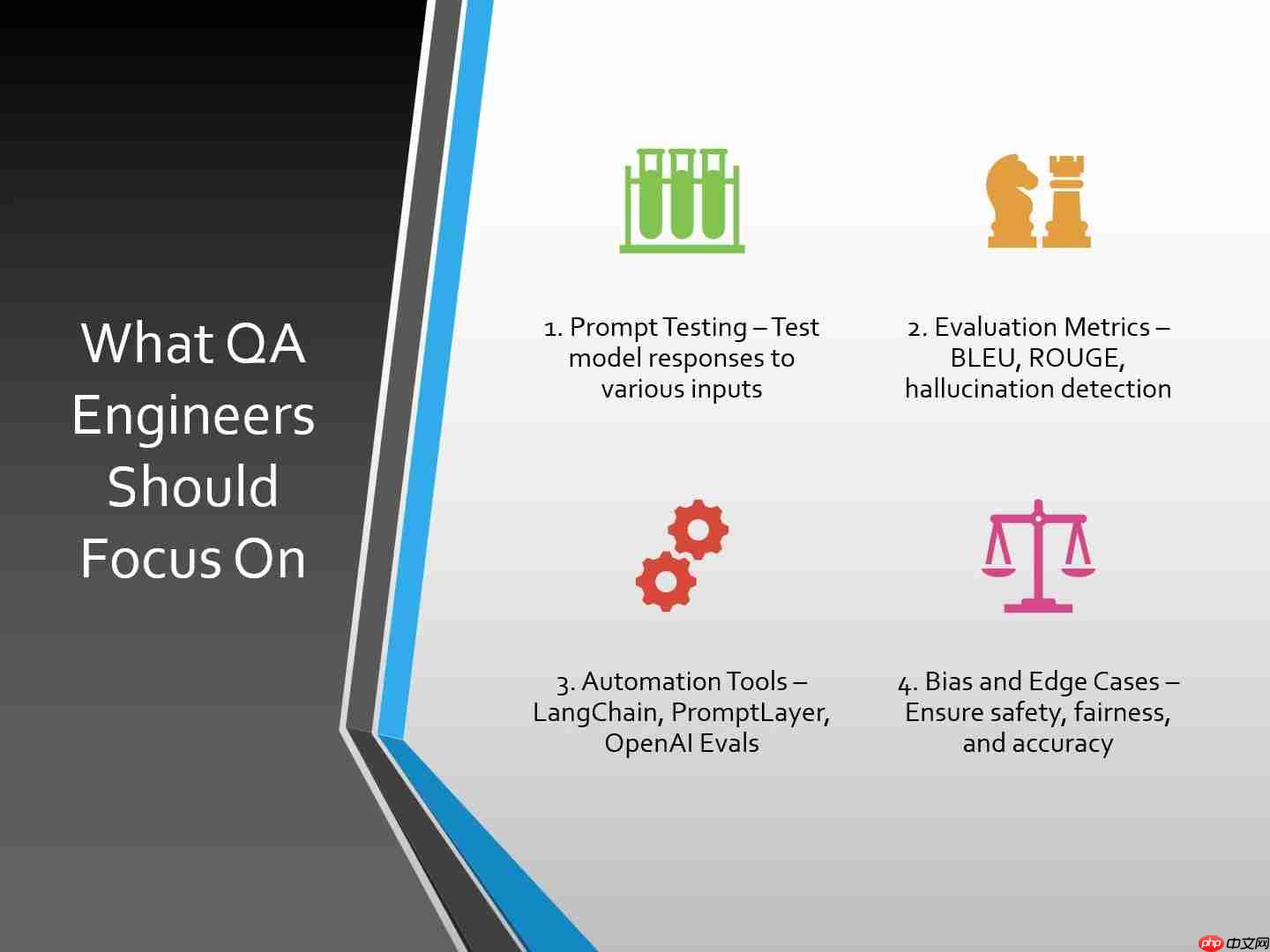

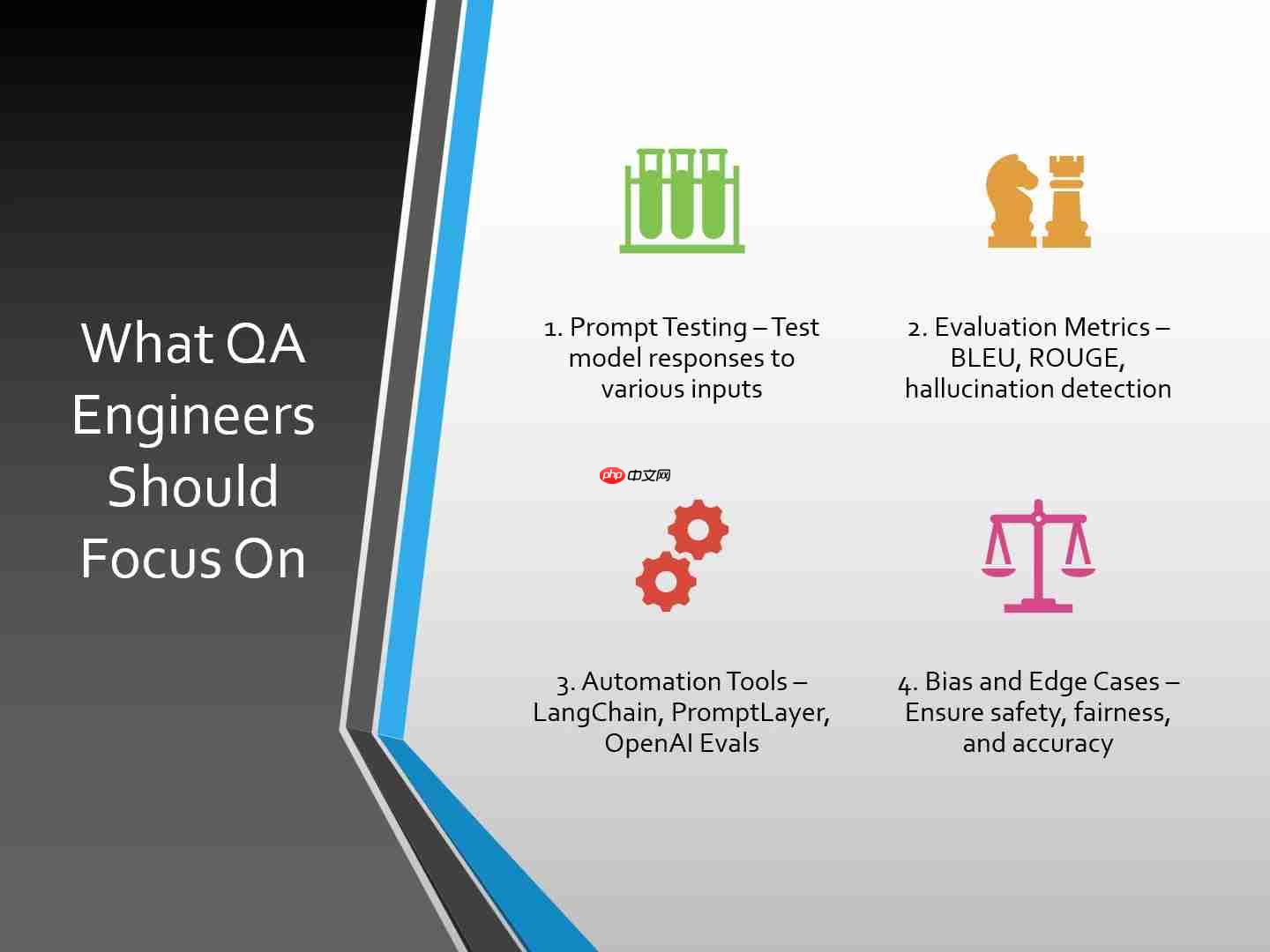

QA工程师应关注提示测试、评估指标、自动化工具以及偏差和边缘案例,以确保LLM的安全性、公平性和准确性。

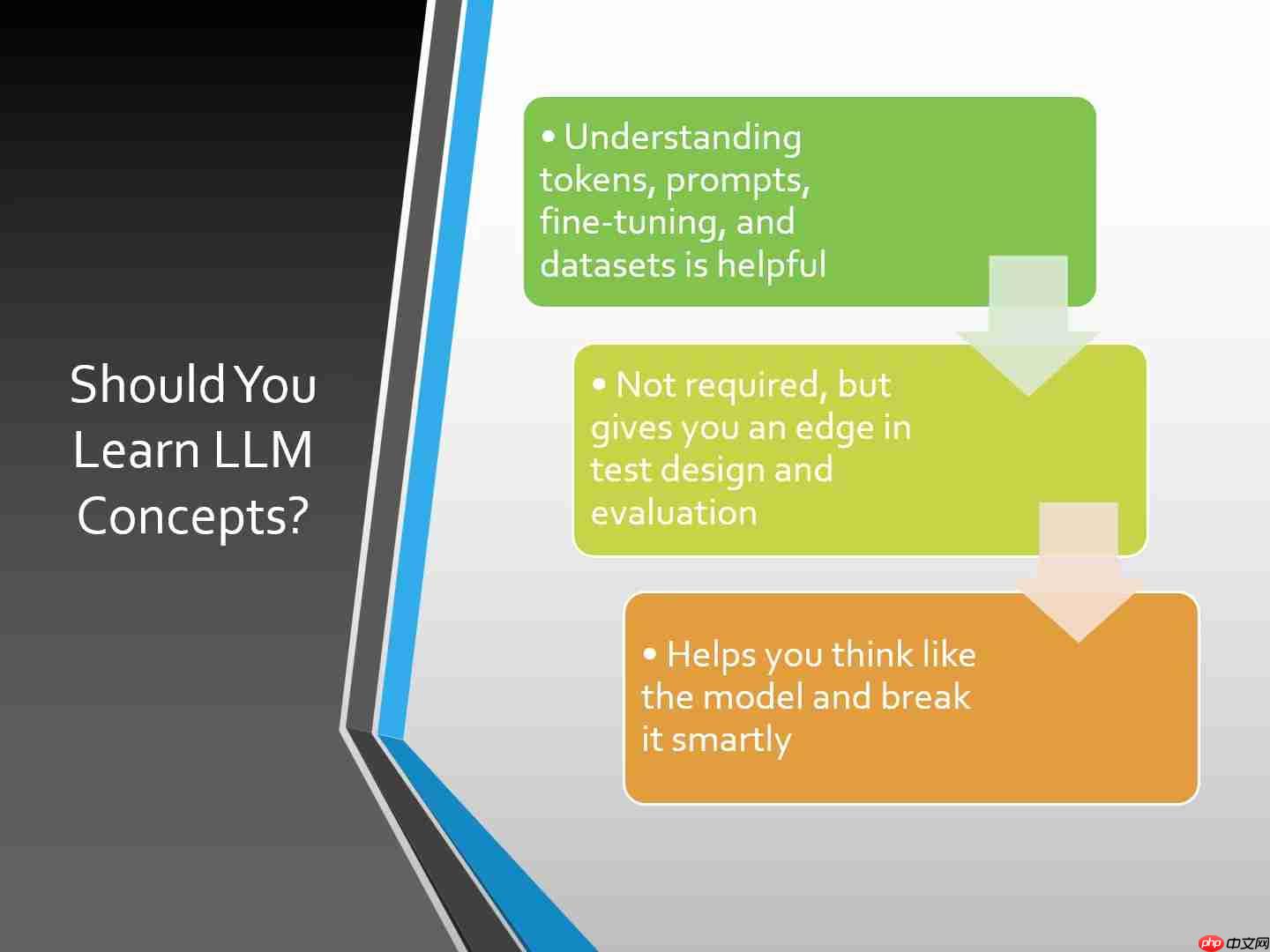

理解tokens、提示、微调和数据集等LLM概念有助于QA工程师更有效地进行测试设计和评估,从而像模型一样思考并巧妙地突破其局限。

LLM基础:QA工程师入门

什么是LLM?

大型语言模型(llm)是人工智能领域的一项重要技术,它通过学习海量的文本数据来理解和生成人类语言。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

LLM能够执行多种自然语言处理(NLP)任务,例如文本生成、机器翻译、问答系统和情感分析等。

LLM的核心特征:

- 海量数据训练: LLM通过在大规模文本数据集上进行训练,学习语言的统计规律和语义信息。这些数据集通常包含数十亿甚至数万亿的单词,涵盖各种主题、风格和语言。

- 深度学习模型: LLM通常基于深度学习模型,例如Transformer网络。这些模型具有强大的表示学习能力,能够捕捉语言中的复杂关系。

- 生成能力: LLM不仅能够理解语言,还能够生成高质量的文本。它们可以根据给定的提示或指令生成文章、故事、对话等。

- 上下文理解: LLM能够理解上下文信息,并根据上下文生成合适的回复。这使得它们在对话系统中表现出色。

随着AI技术的普及,LLM已经渗透到我们生活的方方面面。例如,ChatGPT可以用于撰写邮件、生成代码、进行头脑风暴等,而Gemini则可以用于图像识别、语音助手等。 这些AI工具的广泛应用对qa工程师提出了新的挑战,他们需要掌握LLM的基本原理和测试方法,以确保AI系统的质量和可靠性。

通过理解LLM的基础知识,QA工程师可以更好地应对AI时代的挑战,为AI系统的质量保驾护航。本文将继续深入探讨QA工程师在LLM应用中的角色,重点讨论测试、自动化和评估AI模型。

QA工程师需要深入了解LLM创建吗?

在LLM领域,一个常见的问题是:QA工程师是否需要深入了解LLM的创建过程?答案是:不需要。

QA工程师的主要职责是测试和评估LLM的质量,而不是从头开始构建LLM。

QA工程师与LLM创建者的角色区分:

- LLM创建者(机器学习工程师、数据科学家): 负责设计、训练和优化LLM。他们需要深入了解深度学习、自然语言处理、优化算法等技术。

- QA工程师: 负责测试和评估LLM的质量,包括准确性、可靠性、安全性、公平性等。他们需要掌握测试方法、评估指标、自动化工具等。

类比: 就像你不需要了解汽车发动机的构造才能测试汽车的性能一样,QA工程师也不需要了解LLM的内部机制才能测试其质量。 重要的是,QA工程师需要理解LLM的行为模式,以便进行有效的功能测试和评估。这意味着他们需要了解LLM的输入输出、常见错误、潜在风险等。

虽然深入了解LLM创建过程不是QA工程师的必要条件,但掌握LLM的基本概念和原理可以帮助他们更好地进行测试设计和评估。例如,理解tokens、提示、微调和数据集等概念可以帮助QA工程师更有效地发现LLM中的问题。

QA工程师在LLM测试中的关键领域

提示测试(Prompt Testing)

提示测试是QA工程师在LLM测试中的一个关键领域。

提示是指用户向LLM发出的指令或问题,而提示测试则是通过构造各种不同的提示来测试LLM的响应。

提示测试的目标:

- 测试LLM的准确性: 验证LLM是否能够根据提示给出准确的答案。

- 测试LLM的鲁棒性: 验证LLM在面对模糊、错误或对抗性提示时是否能够保持稳定。

- 测试LLM的安全性: 验证LLM是否会生成有害、不当或违规的内容。

- 测试LLM的公平性: 验证LLM是否会产生偏差或歧视。

提示测试的方法:

- 输入各种类型的提示: 包括简单问题、复杂问题、开放性问题、封闭性问题、假设性问题等。

- 使用不同的提示风格: 包括正式风格、非正式风格、幽默风格、专业风格等。

- 构造对抗性提示: 故意设计一些具有挑战性的提示,例如包含错误信息、模棱两可的指令或具有歧义的陈述。

- 使用自动化工具: 利用自动化工具生成大量的提示,并自动评估LLM的响应。

通过提示测试,QA工程师可以发现LLM在不同场景下的问题,并帮助开发人员改进LLM的性能和安全性。

评估指标(Evaluation Metrics)

评估指标是用于衡量LLM性能的重要工具。

它们可以帮助QA工程师客观地评估LLM的质量,并比较不同LLM的优劣。

常见的LLM评估指标:

- BLEU(Bilingual Evaluation Understudy): 用于衡量机器翻译的质量,通过比较机器翻译的文本与人工翻译的文本之间的相似度来评估。

- ROUGE(Recall-Oriented Understudy for Gisting Evaluation): 用于衡量文本摘要的质量,通过比较机器生成的摘要与人工生成的摘要之间的召回率来评估。

- 准确率(Accuracy): 用于衡量LLM在分类任务中的准确程度。

- F1值(F1 Score): 用于衡量LLM在分类任务中的精确率和召回率的调和平均值。

- 困惑度(Perplexity): 用于衡量LLM在语言建模任务中的性能,困惑度越低,LLM的性能越好。

评估指标的应用:

- 比较不同LLM的性能: 通过使用相同的评估指标,可以比较不同LLM在相同任务上的性能。

- 监控LLM的性能变化: 可以定期使用评估指标来监控LLM的性能变化,例如在进行微调或更新后。

- 识别LLM的问题: 通过分析评估指标的结果,可以识别LLM存在的问题,例如生成不准确的答案或产生偏差。

除了上述常见的评估指标外,还有一些专门用于评估LLM的指标,例如用于检测LLM是否会生成有害内容的指标。QA工程师需要根据具体的测试目标选择合适的评估指标。

标签: 人工智能 edge 工具 ai chatgpt openai gpt 深度学习 金融 自然语言处理 ai工具 常见问题

还木有评论哦,快来抢沙发吧~