在信息爆炸的时代,快速有效地处理大量文档变得至关重要。PDF文档摘要是一个常见的需求,无论是处理研究报告、书籍还是简历,都需要快速提取关键信息。本篇博客将带你了解如何利用N8N的AI Agent功能,构建一个自动化PDF摘要工作流,从而极大地提高工作效率。我们将详细介绍如何设置工作流的每一个环节,从文件读取到AI摘要生成,并提供详细的步骤和示例,确保即使是初学者也能轻松上手。通过本文,你将掌握使用N8N创建强大自动化流程的能力,为你的工作和学习带来便利。

关键要点

使用N8N构建自动化PDF摘要工作流。

利用AI Agent进行高效的文本提取和摘要。

详细步骤演示:文件读取、文本提取、代码优化和AI摘要生成。

如何自定义工作流,以满足不同的摘要需求。

结合Ollama Chat Model,实现本地AI模型集成。

N8N PDF摘要工作流详解

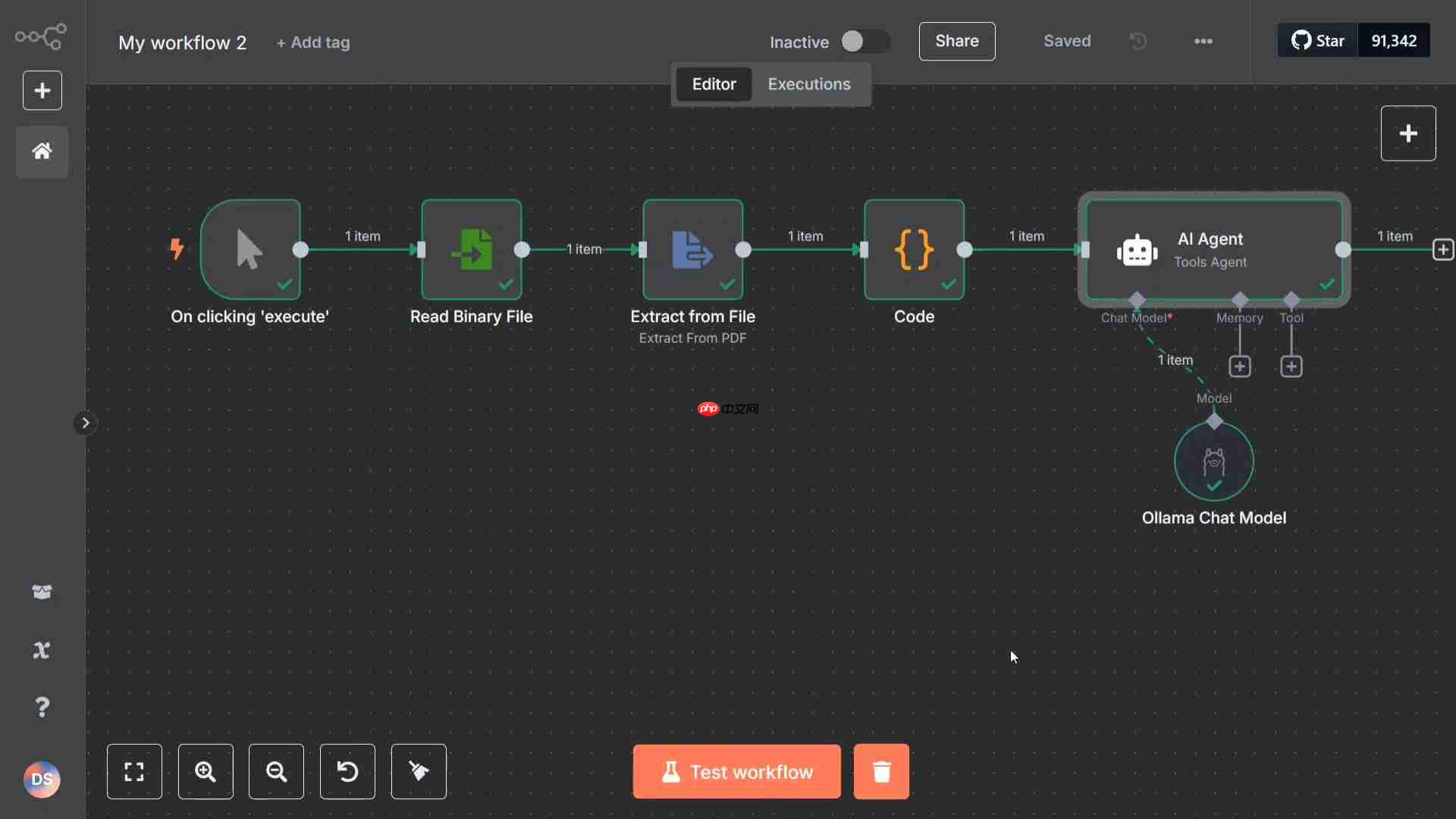

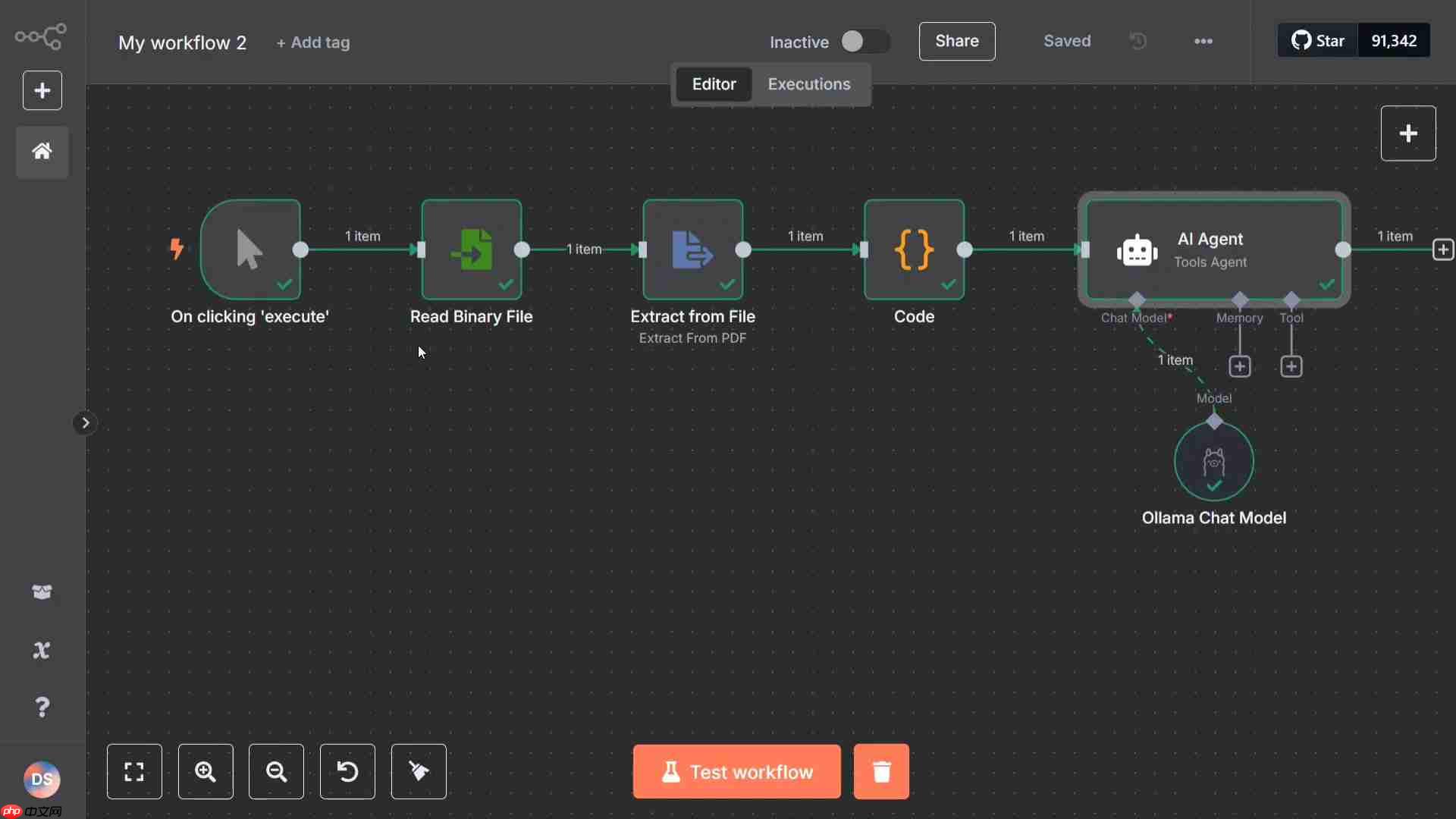

工作流概览

本教程的核心是构建一个能够自动读取pdf文件,提取文本,然后使用ai agent生成摘要的工作流。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

这个工作流可以处理各种类型的PDF文档,包括书籍、研究论文和简历等。其目标是利用N8N的强大功能,简化摘要过程,提高效率。主要步骤包括:

- 手动触发: 工作流通过手动点击'execute'按钮启动。

- 读取二进制文件: 从指定的PDF文件路径读取二进制数据。

- 提取文本: 从PDF文件中提取所有文本内容。

- 代码处理(可选): 对提取的文本进行清洗和预处理,例如去除多余的空格和换行符。

- AI摘要生成: 使用AI Agent和Ollama Chat Model生成最终的摘要。

手动触发节点配置

首先,我们需要设置手动触发节点,允许我们手动启动工作流。

在N8N界面中,选择'Trigger manually'作为起始节点。这个节点非常简单,只需要确保它被正确连接到后续的节点即可。手动触发节点提供了一个方便的方式来测试和运行工作流,特别是在开发和调试阶段。

读取二进制文件节点配置

接下来,配置读取二进制文件节点,用于从指定的PDF文件路径读取数据。

该节点需要指定PDF文件的完整路径。例如:C:\Users\data\OneDrive\Desktop\Essay_on_India.pdf。

请确保N8N服务器有权限访问该路径,并且文件确实存在。正确的配置将确保PDF文件被成功加载,为后续的文本提取做好准备。这个节点的主要作用是将PDF文件转换为N8N可以处理的二进制格式,以便后续节点可以提取其中的文本信息。文件路径需要提供完整路径,这样N8N才能准确找到文件。

提取文本节点配置

提取文本节点负责从加载的PDF文件中提取所有文本内容。

该节点使用'Extract from File'操作,并选择'Extract from PDF'选项。关键配置包括:

- Operation: 'Extract from PDF'

- Input Binary Field: 'data'

确保输入二进制字段设置为'data',因为这是前一个节点传递过来的数据变量名称。 这个节点会将PDF文件中的文本内容提取出来,并传递给下一个节点进行处理。成功配置后,你可以在该节点的输出中看到提取的文本内容。

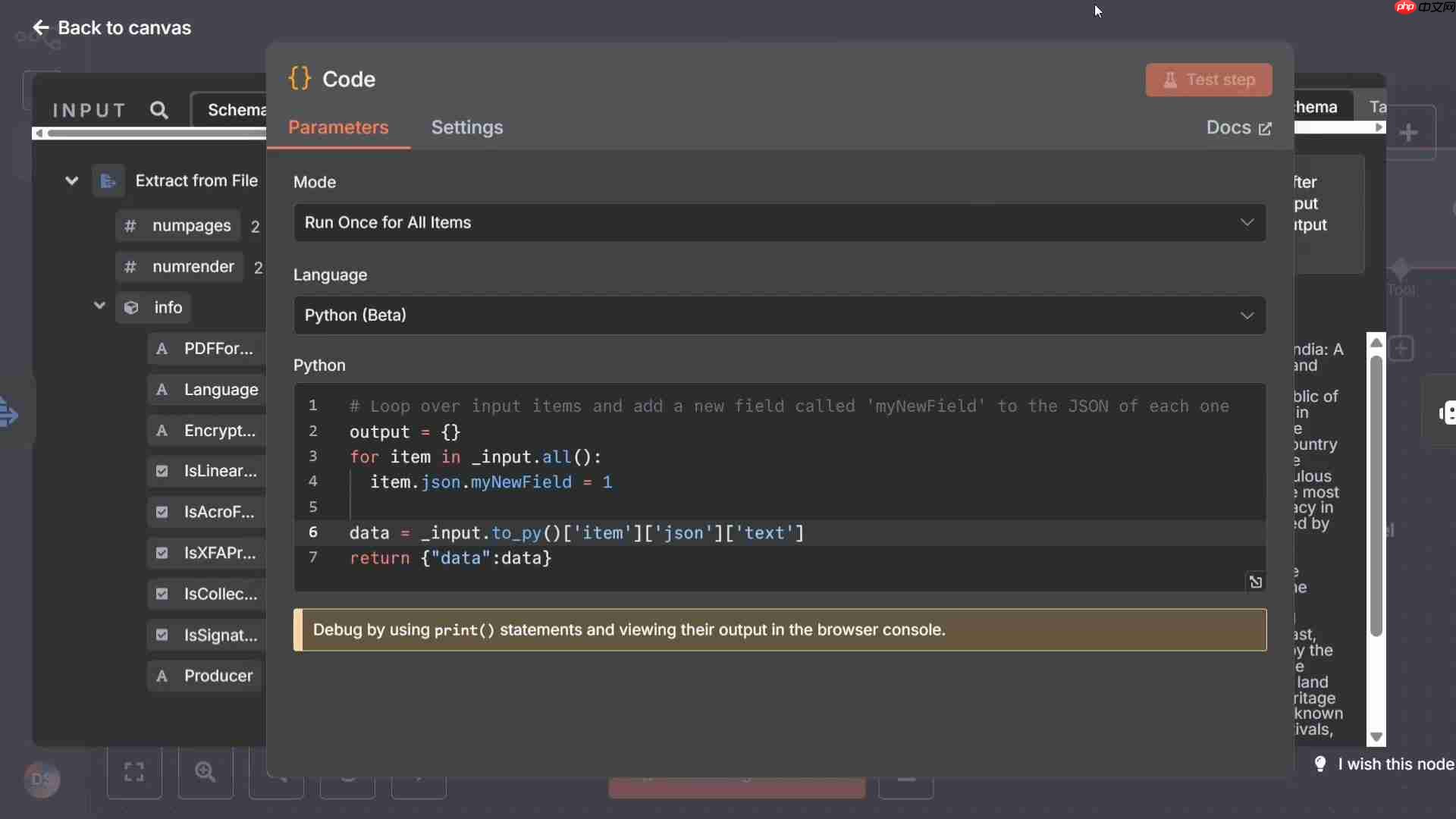

代码处理节点配置(可选)

代码处理节点是一个可选的中间步骤,用于对提取的文本进行清洗和预处理。

你可以使用JavaScript或Python代码来去除文本中的多余空格、换行符或其他不需要的字符。例如,以下Python代码可以去除文本中的多余空格:

output = {}

for item in input.all():

item.json.myNewField = 1

data = _input_to_py(item)['item']['json']['text']

return {"data":data}登录后复制

这个节点的主要目的是为了提高后续AI摘要生成的质量。 通过清洗文本,可以减少噪音,使AI模型更容易提取关键信息。虽然是可选步骤,但建议根据实际需求进行配置,以获得更好的摘要效果。您可以在这个环节添加您自己的自定义代码,以便更加适配您的PDF文件。

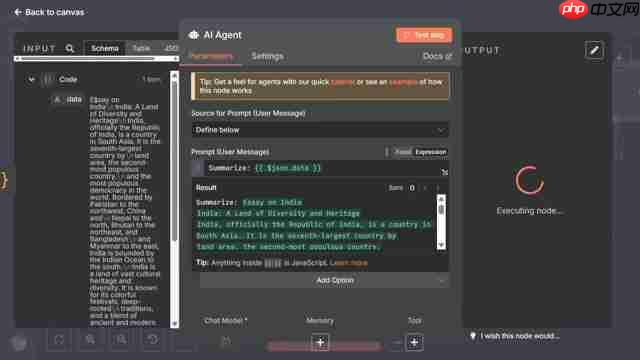

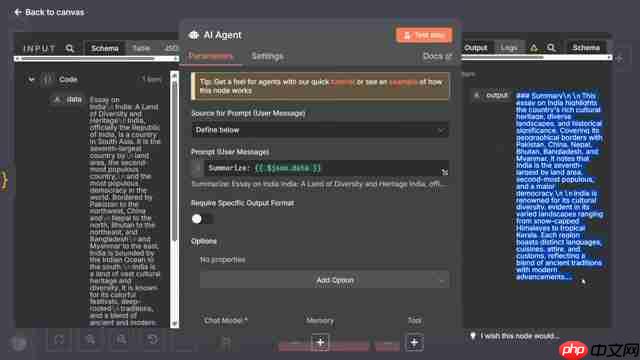

AI摘要生成节点配置

最后,配置AI摘要生成节点,使用AI Agent和Ollama Chat Model生成最终的摘要。

关键配置包括:

- Source for Prompt (User Message): Define below

-

Prompt (User Message): Summarize:

{{$json.data}}

在'Prompt (User Message)'字段中,我们使用了一个简单的提示语'Summarize:',并引用了前一个节点传递过来的数据变量'json.data'。 该节点会将提取的文本内容传递给Ollama Chat Model,并要求其生成摘要。

Ollama Chat Model是一个本地AI模型,你需要在本地安装并加载该模型。你可以选择不同的Ollama模型,例如qwen2.5:latest或llama3.2等。请确保选择适合你需求的模型,并正确配置Ollama账户。

此外,您可以通过修改Prompt指令来调整摘要的风格,长度等信息。您还可以选择不同的AI Model来实现不同的效果。

标签: javascript word python java js json go 操作系统 工具 ai pdf openai

还木有评论哦,快来抢沙发吧~