在日益互联互通的世界中,沟通是连接人与人之间桥梁的关键。然而,对于那些听力受损或有语言障碍的人来说,沟通的道路上充满了挑战。据世界卫生组织统计,全球约有4.66亿人患有残疾性听力损失。在中国,这个数字也相当庞大,这其中有大量的儿童,他们正面临着因听力障碍而导致的教育、社交等问题。幸运的是,人工智能(AI)技术的快速发展,为解决这些问题提供了新的希望。AI手语识别技术正以惊人的速度发展,它不仅可以帮助听力障碍者更好地融入社会,还在教育、医疗、就业等领域展现出巨大的潜力。 本文将深入探讨AI手语识别技术的原理、应用、以及它如何打破沟通壁垒,为无声世界带来变革。

关键要点

全球有数百万听力受损人群,沟通是他们融入社会的最大挑战。

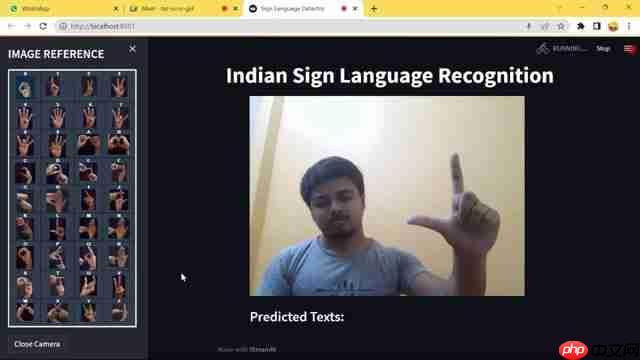

AI手语识别技术利用计算机视觉和深度学习,将手语翻译成文字或语音。

该技术在教育、医疗保健、公共服务等领域具有广泛的应用前景。

AI手语识别有助于提高聋哑人的生活质量,促进社会包容。

实时语音输出功能可以帮助健全人理解手语,促进双方有效交流。

参考图像辅助功能可以帮助用户学习标准手语。

AI手语识别技术:沟通的桥梁

什么是AI手语识别技术?

ai手语识别技术是一种利用人工智能算法,特别是计算机视觉和深度学习,将手语翻译成可理解的文字或语音的技术。 传统的手语交流需要翻译人员,这不仅成本高昂,也存在时间滞后等问题。而ai手语识别技术的出现,有望打破这一瓶颈,实现实时、便捷的手语翻译。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

AI手语识别不仅能够识别单个手势,还能理解手语的语法和语境,从而实现更准确、流畅的翻译。该技术通过摄像头捕捉手语使用者的动作,然后将这些动作与预先训练好的模型进行比对,最终输出对应的文字或语音信息。

随着人工智能的不断发展,手语识别技术也在不断完善。未来的AI手语识别系统将更加智能化、个性化,能够适应不同的手语风格和表达习惯,为听力障碍者提供更加精准、自然的沟通体验。

AI手语识别技术的原理

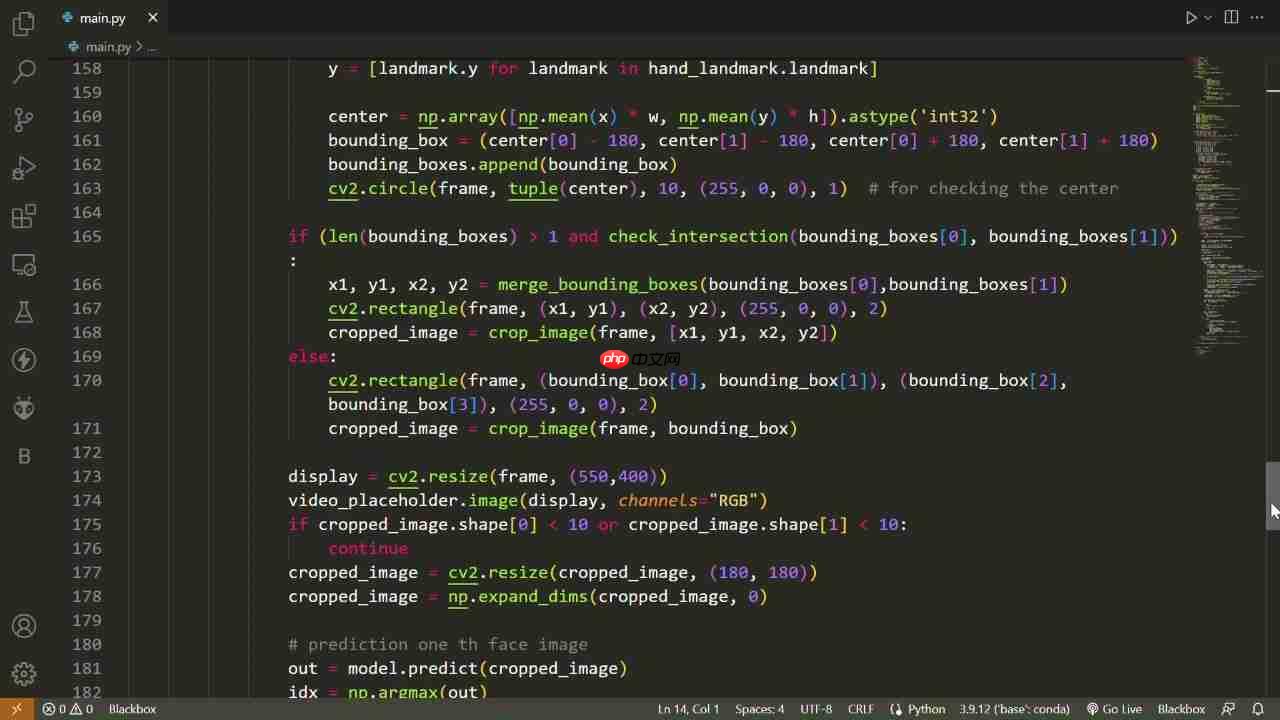

AI手语识别技术的核心在于模式识别。它通过以下几个步骤实现手语的自动翻译:

-

图像采集:利用摄像头或其他传感器捕捉手语使用者的手部动作和面部表情。

-

特征提取:通过计算机视觉算法,从采集到的图像或视频中提取关键特征,如手的位置、形状、运动轨迹等。

-

模型训练:使用大量的手语数据集对深度学习模型进行训练,使其能够准确地识别不同的手语动作。

-

手语翻译:将提取到的特征输入到训练好的模型中,模型会根据这些特征预测对应的文字或语音信息。

深度学习在手语识别中发挥着至关重要的作用。通过构建多层神经网络,深度学习模型能够自动学习手语中的复杂模式和关联性,从而提高识别的准确率和鲁棒性。

此外,自然语言处理(NLP)技术也被广泛应用于AI手语识别中。NLP技术可以帮助系统理解手语的语境和含义,从而生成更自然、流畅的翻译结果。

AI手语识别的应用场景

教育领域:AI手语识别可以帮助听力障碍学生更好地参与课堂学习。通过实时手语翻译,教师和学生可以更方便地进行互动交流。

医疗保健领域:在医疗机构中,AI手语识别可以帮助医护人员与听力障碍患者进行有效沟通,提高医疗服务质量。

公共服务领域:政府机构、银行、交通部门等可以利用AI手语识别技术,为听力障碍者提供无障碍服务。

标签: 计算机 人工智能 app 电脑 平板 ai 神经网络 深度学习 自然语言处理 平板电脑 应用商店 常见问题

还木有评论哦,快来抢沙发吧~