在人工智能 (AI) 领域,图像识别是一项至关重要的技术,它使计算机能够像人类一样“看”和理解图像。卷积神经网络 (CNN) 作为一种深度学习模型,已成为 AI 图像识别领域的主流技术。本文旨在深入探讨 CNN 在 AI 图像识别中的应用,揭示其工作原理、突出优势,并展望未来发展前景。通过本文,您将全面了解 CNN 如何赋能 AI 图像识别,以及它在各个行业中的广泛应用。让我们一起探索 CNN 的奥秘,领略 AI 图像识别的魅力!

关键要点

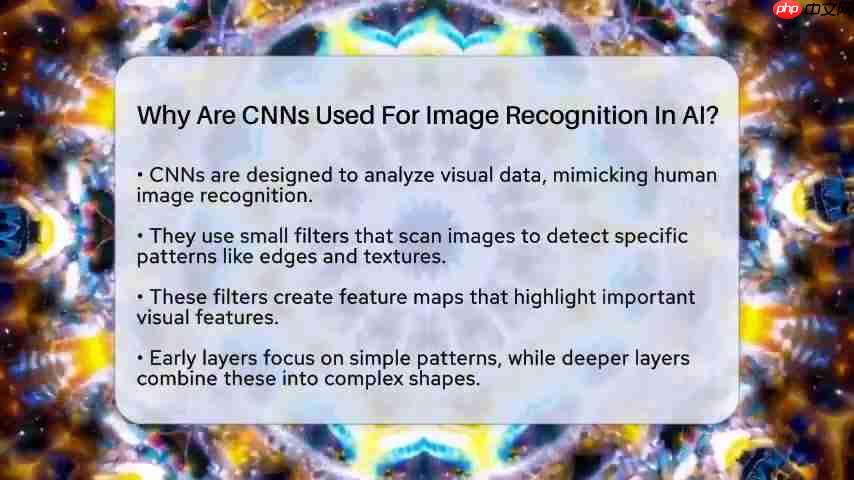

CNN 是一种专门用于处理图像数据的深度学习模型。

CNN 通过卷积、池化和全连接等操作,提取图像特征并进行分类。

CNN 具有自动学习特征、空间不变性和高效性等优势。

CNN 广泛应用于人脸识别、物体检测、医学图像分析等领域。

CNN 的发展趋势包括模型优化、可解释性和泛化能力提升。

理解 CNN 的基础

什么是卷积神经网络(CNN)?

卷积神经网络(cnn)是一种专门设计用于处理具有网格结构的数据的深度学习算法,如图像(可以看作是像素网格)。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

传统神经网络在处理图像时,需要将图像展开成一维向量,这会丢失图像的空间信息,并且参数量巨大。CNN 通过卷积层、池化层等特殊结构,能够有效地提取图像特征,并减少参数量。

CNN 的核心思想是局部感受野、权值共享和池化。局部感受野是指每个神经元只关注输入图像的一个局部区域;权值共享是指同一个卷积核在整个图像上进行卷积,从而减少参数量;池化是指对卷积后的特征图进行降采样,从而减少计算量,并提高模型的鲁棒性。

关键词重复:卷积神经网络,图像

CNN 的核心组成部分

一个典型的 CNN 架构通常包含以下几个核心组成部分:

- 卷积层(Convolutional Layer): 这是 CNN 的核心层,通过卷积核(也称为滤波器)在输入图像上滑动,提取局部特征。每个卷积核学习一种特定的图像特征,例如边缘、角点或纹理。通过多个卷积核,可以提取图像的多种特征。

- 激活函数(Activation Function): 激活函数引入非线性因素,使 CNN 能够学习复杂的图像模式。常用的激活函数包括 ReLU、Sigmoid 和 Tanh。

- 池化层(Pooling Layer): 池化层对卷积层输出的特征图进行降采样,减少计算量,并提高模型的鲁棒性。常用的池化操作包括最大池化和平均池化。

- 全连接层(Fully Connected Layer): 在 CNN 的末端,通常会连接几个全连接层,用于将提取的特征映射到最终的类别标签。全连接层与传统神经网络类似,每个神经元都与前一层的所有神经元相连。

关键词重复:卷积层,激活函数,池化层

CNN 相较于传统神经网络的优势

CNN 的优势详解

CNN 之所以在图像识别领域表现出色,主要归功于其以下几个显著优势:

-

自动学习特征: CNN 能够从原始图像数据中自动学习特征,无需人工设计特征提取器。

这一特性极大地简化了图像识别系统的开发流程,并提高了系统的性能。传统方法需要人工设计特征提取器,这需要大量的专业知识和经验,并且难以提取到最优特征。

- 空间不变性: CNN 的卷积操作具有空间不变性,即无论图像中的物体出现在哪个位置,CNN 都能识别出来。这是因为卷积核在整个图像上进行滑动,能够检测到物体在不同位置的相同特征。这一特性使得 CNN 能够更好地处理图像中的物体位置变化。

- 高效性: CNN 的权值共享和池化操作能够有效地减少参数量和计算量,使得 CNN 能够处理大规模图像数据。 传统神经网络在处理图像时,参数量巨大,容易过拟合,并且计算量大,难以训练。CNN 通过权值共享和池化操作,有效地解决了这些问题。

关键词重复:卷积神经网络,图像特征,空间不变性

标签: 计算机 人工智能 ai 神经网络 深度学习 人脸识别 pytorch 自然语言处理 区别 常见问题 库存管理

还木有评论哦,快来抢沙发吧~