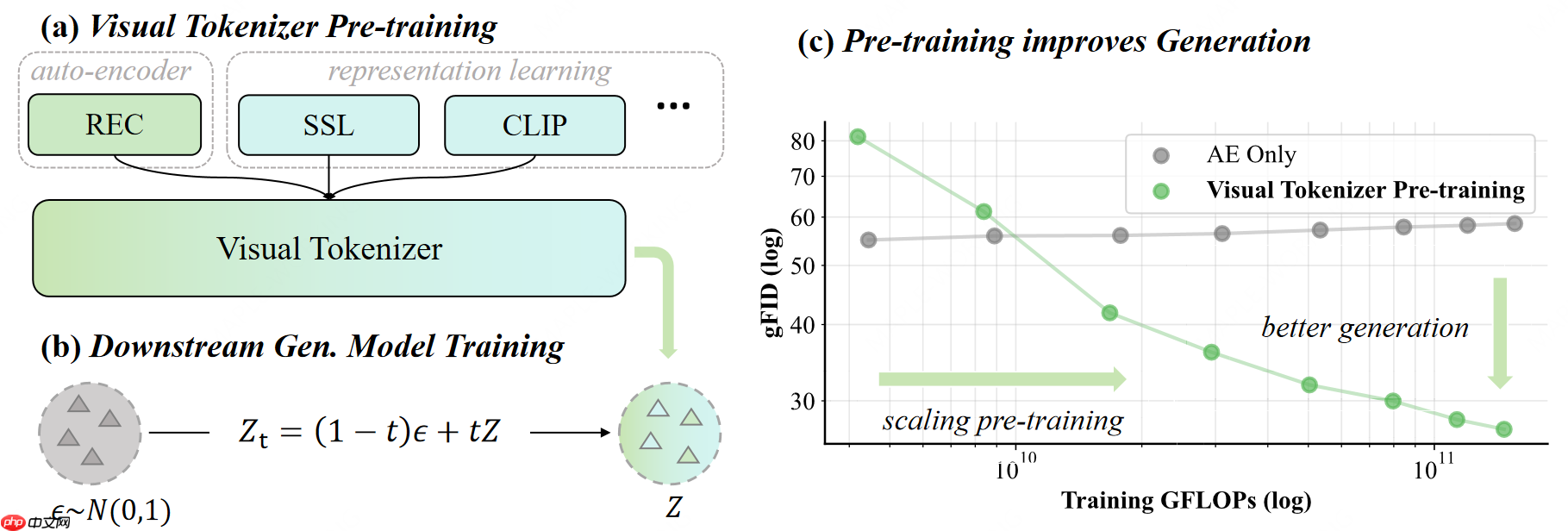

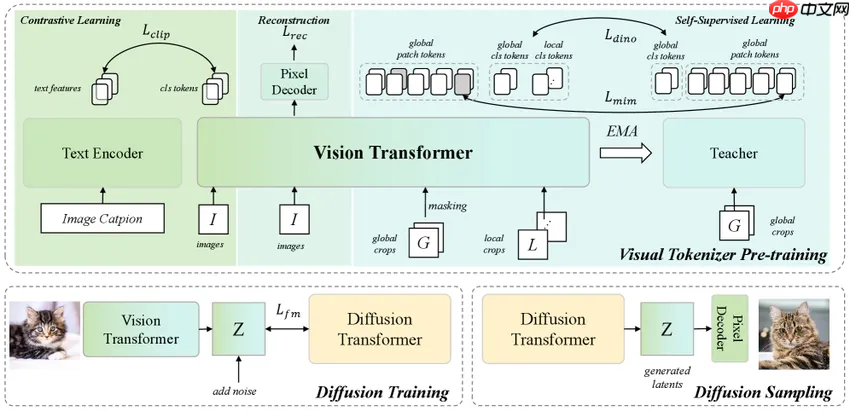

minimax 联合华中科技大学首次对外开源其视觉生成核心技术——vtp(visual tokenizer pretraining,视觉分词器预训练)。该技术在不改动标准dit架构的前提下,仅通过对视觉分词器(visual tokenizers)进行扩展与优化,便实现了高达 65.8% 的端到端生成性能提升。

区别于多数分词器相关研究,VTP 的设计理念强调“零侵入”:它完全不干预下游主干模型(如 DiT)的训练流程,所有改进均集中在前置的 tokenizer 模块上,从而以极低耦合代价达成生成质量的显著跃升。

VTP 预训练范式如下:

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。

还木有评论哦,快来抢沙发吧~